こちらのCGメソッドの記事では「FaceRigのアニメーションデータ(.rpl)をLive2Dへ移行する方法」を紹介します!キーを調整できるのでブラッシュアップし放題です!

GUIで変換!「Moli」の使い方

FaceRigで作成したアニメーション(rpl)データをキー情報に変換するツール「Moli」の使い方の紹介です。

作成者はときなしさん(@KalsaKey)です。

[timeline]

[tl label=’STEP.1′ title=’FaceRigで動きを保存’]

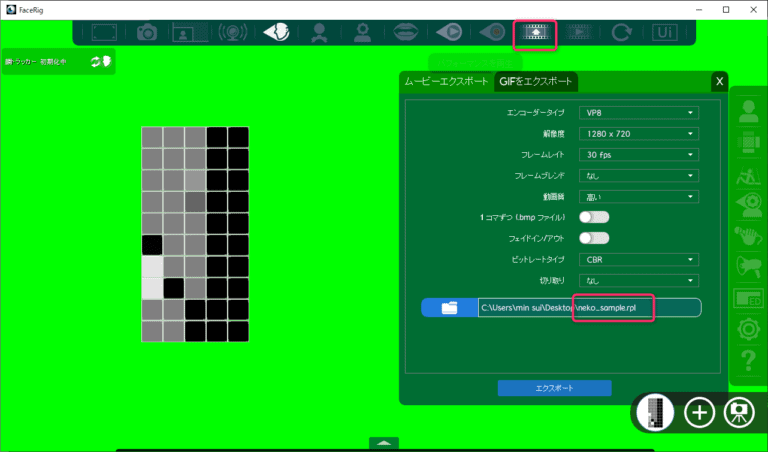

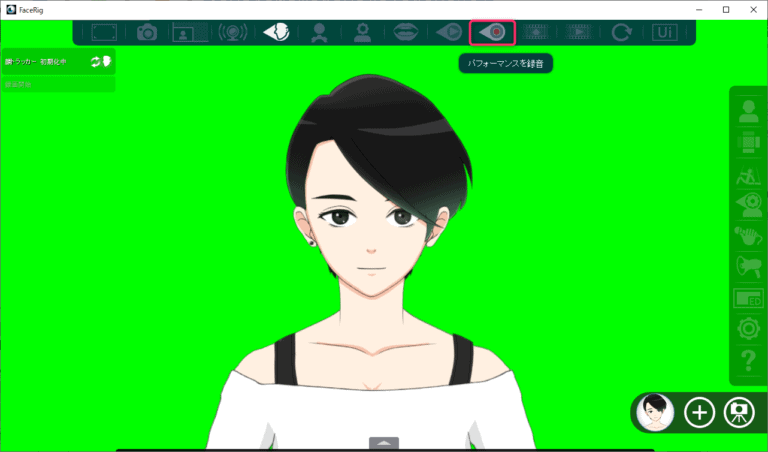

まずはFaceRigで好きなアバターの動きをキャプチャします。

上部メニュー「パフォーマンスの録音」

[/tl]

[tl label=’STEP.2′ title=’「MoliModel」での動画を作成’]

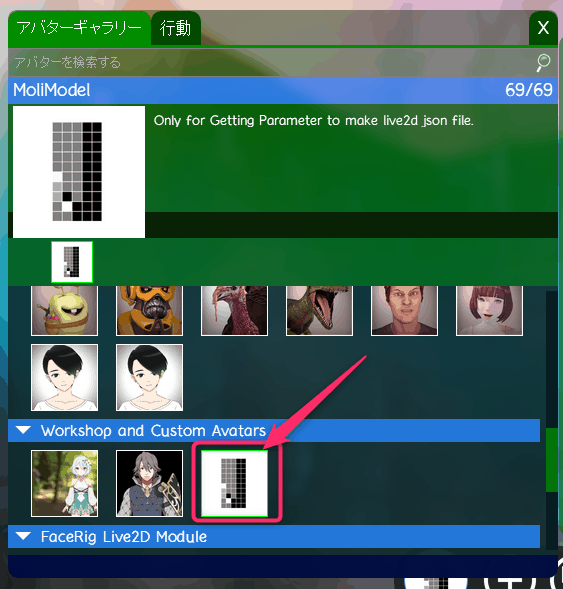

下記のStemaサイトから「MoliModel」のサブスクライブ(登録)ボタンを押します。

https://steamcommunity.com/sharedfiles/filedetails/?id=1826949337

以上でFaceRigのAvatarを見てみると「MoliModel」が登録されているのが確認できます

「MoliModel」を選択して「ムービーとしてパフォーマンスをエクスポート」しましょう。

これでパラメーターをキーに変換できる動画の作成が完了です。

あとは「Moli」を使ってキー情報を出力しましょう!

[/tl]

[tl label=’STEP.3′ title=’「Moli」のダウンロード’]

pixiv fanboxからダウンロードします。今回は最新の「Moli ver2.00」

https://tokinashi.fanbox.cc/posts/1078835

[/tl]

[tl label=’STEP.4′ title=’「Moli」のダウンロード’]

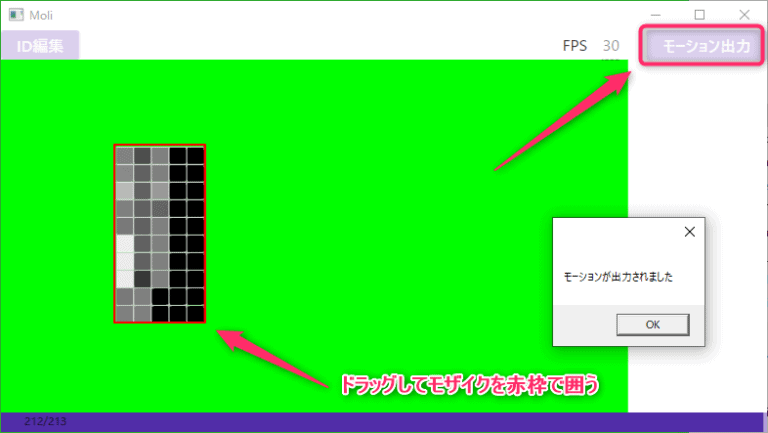

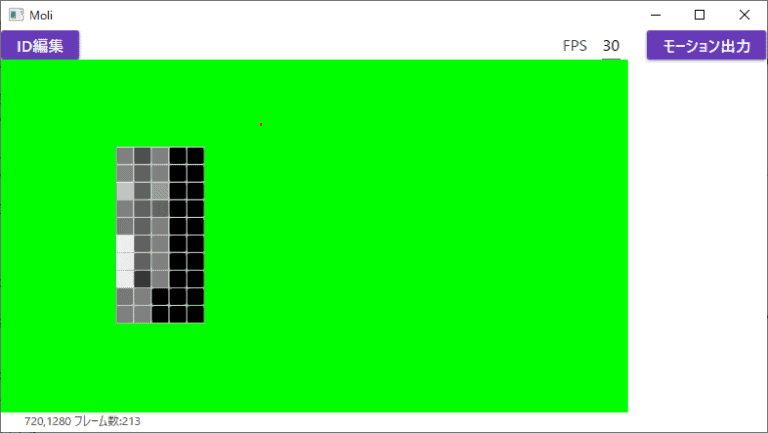

・ダウンロードしたデータの中の「Moli.exe」を起動します。

・録画した動画をドラッグ&ドロップ

・最後にモーション出力ボタンを押せばOK

「○○.motion3.json」というデータが保存されます

[/tl]

[tl label=’STEP.5′ title=’「Moli」のダウンロード’]

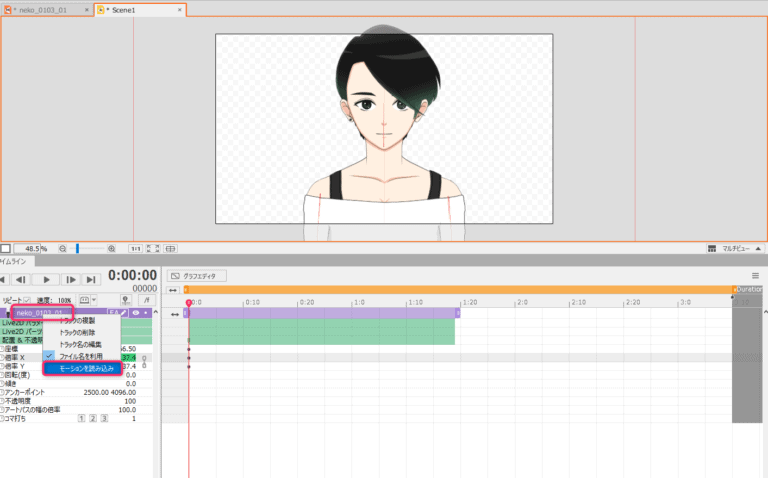

最後にLive2Dを起動して、アニメーターにモデルを表示。右クリック>「モーションを読み込み」を選び、先程の「○○.motion3.json」を読み込みましょう

以上でキーが読み込まれました!

[/timeline]

GUIで変換!「Moli」の使い方まとめ

やってみると超簡単ですね!

FaceRigのモーションをLive2Dで調整できるので無限にクオリティUPできます!是非ためしてみてください。

ちなみにプログラムが扱える人は下記の方法もおすすめです。

コマンドで変換! FaceRigRplToLive2DMotio3Jsonの使い方まとめ

ガネーシャさん(@Ganeesya)の作成されたFaceRigRplToLive2DMotio3JsonでFaceRigのモーションデータをLive2Dへ持っていってみました!

そのやり方の紹介です。

話題のFaceRigRplToLive2DMotio3Json(@Ganeesya)を試してみました。

おおよそのアニメーション情報が取得されている感じです!

(目線が反れぎみだったのでViewerで少しオフセット)#睡井眠子 #facerig #Live2D #VTuber pic.twitter.com/OMz0w99HIR— 睡井眠子@CGメソッド (@cg_method) 2018年9月12日

※FaceRigを使うのでWindows想定です。

FaceRigのモーションデータを用意

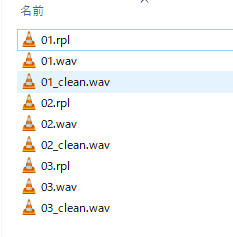

- FaceRigでLive2Dに持っていきたいアニメーションデータをいくつか保存します。(※かならず複数個作成すること、5個以上は用意!)

Pythonのインストール

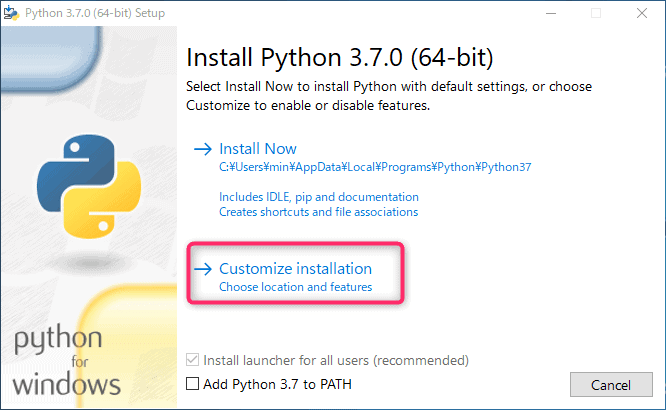

- まずPythonのインストールをします。下記のURLからダウンロード

https://www.python.org/downloads/

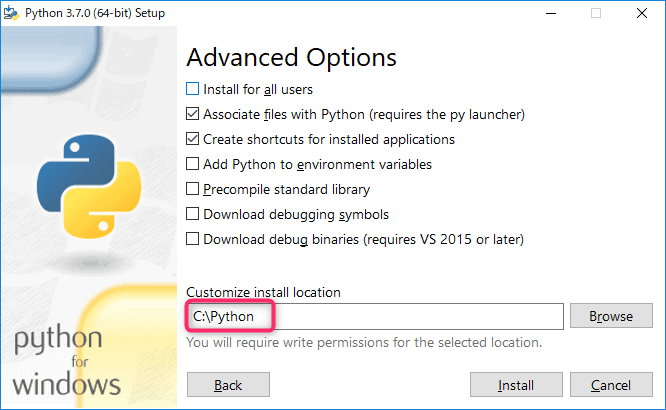

- インストールはカスタム(Customize installation)を選択します

- インストール先をC:Pythonに ※デフォルトだと深い階層になってコマンドが指定しにくいので

FaceRigRplToLive2DMotio3Jsonのダウンロードと設定

- 下記のULRからデータをダウンロード

https://github.com/Ganeesya/FaceRigRplToLive2DMotio3Json

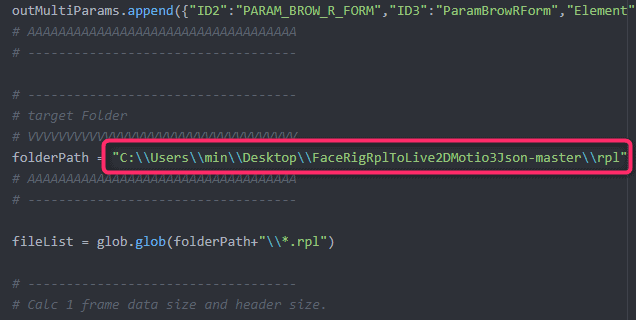

- FaceRigRPL.pyを適当なエディタで開きます

- folderPath = “Set Your rpl files folder path.”と書かれている記述を探して下記の様に先のrplの格納されているフォルダのパスを入力します

folderPath = "C:Users<ユーザー名>Desktop/test"

※パスのバックスラッシュは()は2つにしておくこと

plotlyエラーがでる場合

ModuleNotFoundError: No module named 'plotly'

とかエラーが出る場合は

#import plotly.offline as po

#import plotly.graph_objs as go

を#をつけてコメントアウトする

スクリプトの実行

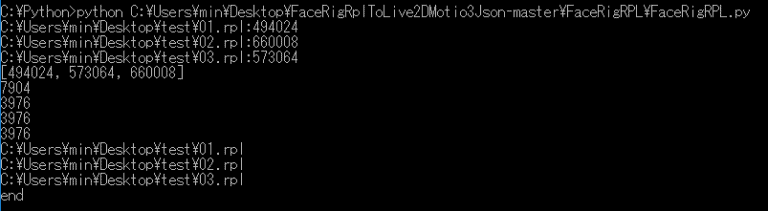

- Windowsの検索から「cmd」とうち、コマンドプロンプトを起動します。

-

Pythonのディレクトリへ移動

cd C:Python

- FaceRigRPL.pyを実行

pythonのあとにFaceRigRPL.pyのパスを入力して実行

python C:Users\ユーザー名\Desktop\\FaceRigRplToLive2DMotio3Json-master\FaceRigRPL\FaceRigRPL.py

とか

‘python’ は、内部コマンドまたは外部コマンド、

操作可能なプログラムまたはバッチ ファイルとして認識されていません。

と出る場合はパスを全部書く

C:Users<ユーザー名>DesktopFaceRigRplToLive2DMotio3Json-masterFaceRigRPL>C:Users\ユーザー名\Desktop\\FaceRigRplToLive2DMotio3Json-master\FaceRigRPL\FaceRigRPL.py

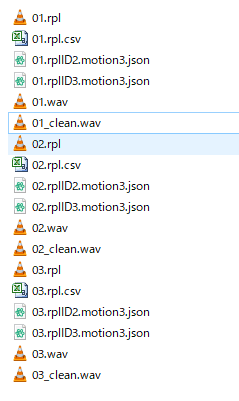

- 変換後のデータを確認します

.csvとパラメーターの大文字小文字だけが違う.jsonが追加されています

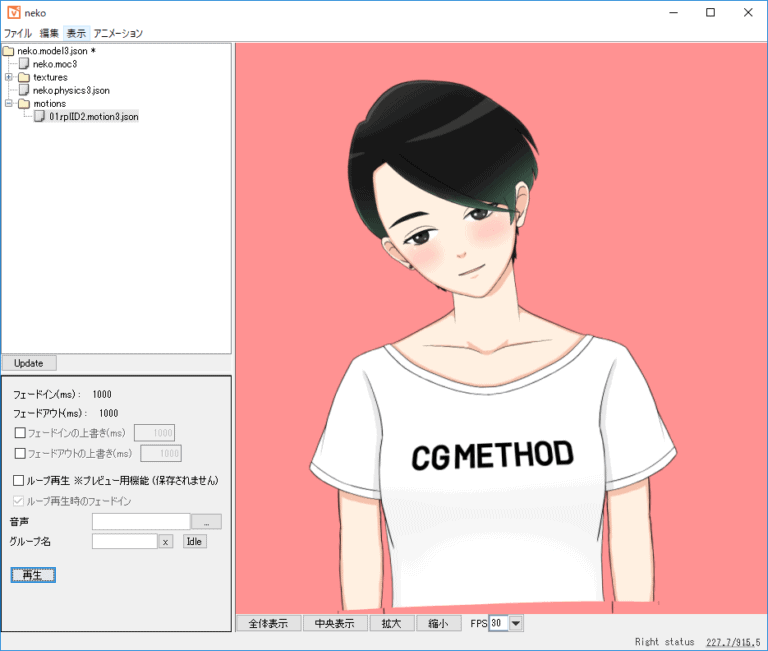

Live2D Viewerで確認

mocを入れてモデルを表示した後、01.rplID2.motion3.jsonもドラッグ&ドロップします。

話題のFaceRigRplToLive2DMotio3Json(@Ganeesya)を試してみました。

おおよそのアニメーション情報が取得されている感じです!

(目線が反れぎみだったのでViewerで少しオフセット)#睡井眠子 #facerig #Live2D #VTuber pic.twitter.com/OMz0w99HIR— 睡井眠子@CGメソッド (@cg_method) 2018年9月12日

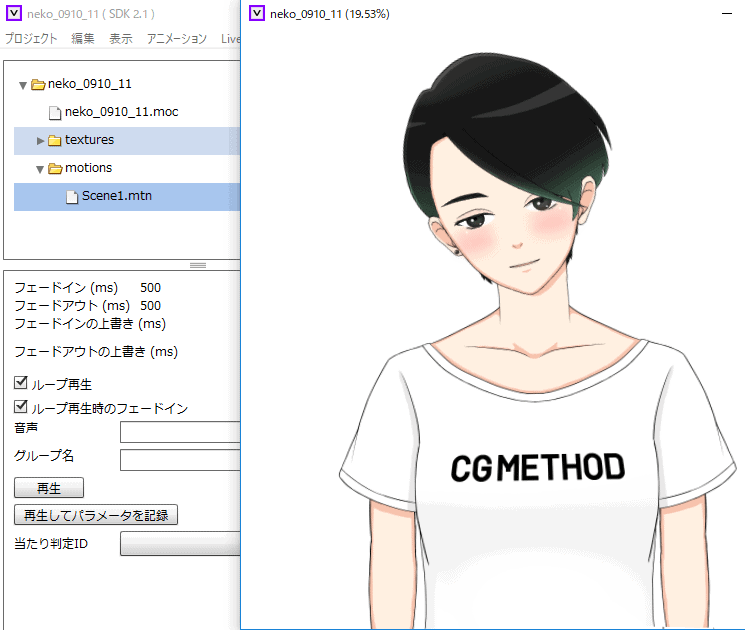

Live2D Animatorでアニメーションをインポート

- Live2Dを立ち上げAnimatorに切り替えて、モデルをいれます。

-

タイムラインのモデル名を右クリックしてモーションを読み込みを選択します

json(01.rplID2.motion3.json)を選択すればアニメーションが読み込まれます

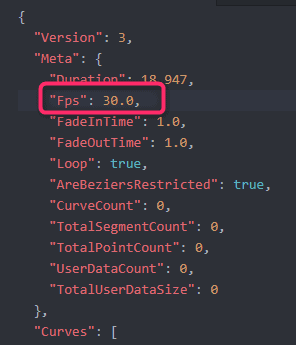

※FPSが変わっていることがあるので、ちゃんと確認してからインポートすることをおすすめします。

mtnに変換する方法

ちなみに2系で使いたい場合は

ファイル>組込み用ファイル書き出し>モーションファイルの書き出しから

2.1形式(mtn)として書き出しを選択すればmtnに変換して出力できます。

備考

バイナリを解析することはデザイナーにとっては難しいので、このツールは非常に助かります!

これでFaceRigのアニメーションを手作業で修正できるので、よりクオリティの高い表現ができる可能性があります。

ちなみに複数の.rplを用意したのは、なかの余計な記述を削除するために差分をみてるようなので、かならず複数個入れた状態でコンバートするとより精度の高いコンバートができます。

FaceRigアニメーションをLive2Dへ移行した動画

上記の技術を生かした動画を作成してみました。

体の動きだけFaceRigでつけて、アニメーション情報をLive2Dアニメーターで移行して目パチと口パクを付けてています。

FaceRigアニメーションをLive2Dへ移行した動画2

追記(2019/5/3)です、PV作成してみました。

ちなみに髪などの物理演算のアニメーションは

アニメーション>トラック>物理演算をアニメーションベイクでキーが生成されます。

作成するべきFaceRig用Live2Dのパラメーターをまとめました!

[card2 id=”1417″ target=”_blank”]

モデルのクオリティアップする方法を書きました!

[card2 id=”2969″ target=”_blank”]